Comment l’IA change-t-elle ce que signifie être chercheur ?

De l’érudition-accumulation à l’intelligence de navigation

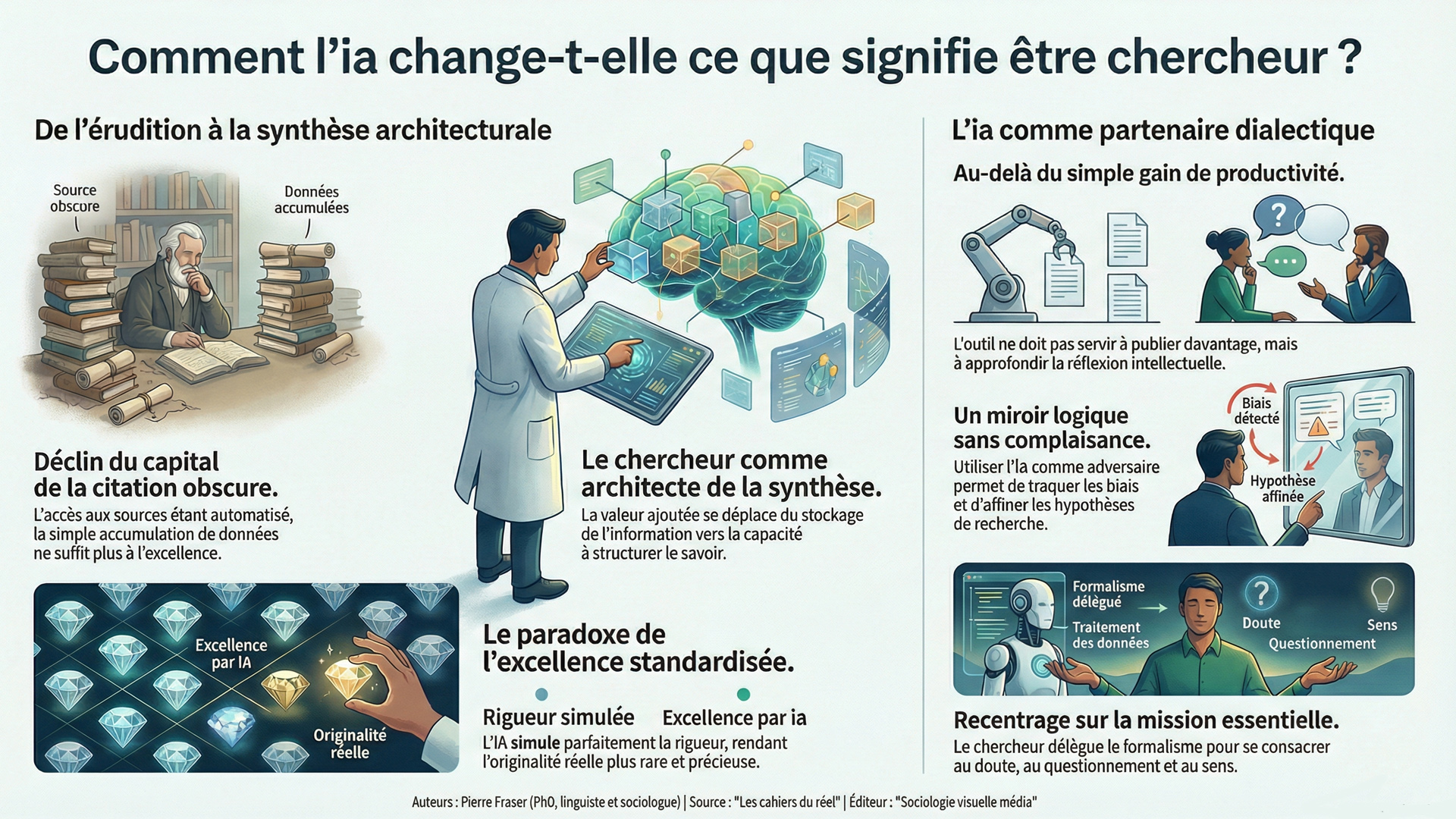

Le prestige académique s’est longtemps cristallisé autour d’une forme d’héroïsme de la source citée. On se souvient de cette époque, pas si lointaine, où la valeur d’un chercheur se mesurait à l’épaisseur de son carnet d’adresses bibliographique et à sa capacité à exhumer un document de Mai 1968 resté dans l’ombre. C’était l’ère du super-pouvoir documentaire : l’érudition fonctionnait comme un capital symbolique rare, une distinction fondée sur l’accès privilégié à l’information.

Aujourd’hui, ce capital s’évapore. Dans un monde de données omnidisponibles, la citation obscure n’impressionne plus, car elle n’est plus le fruit d’une quête physique dans des rayonnages poussiéreux, mais le résultat d’une simple requête algorithmique. Ce n’est pas la fin du savoir, mais la fin de la sacralisation de son stockage. Le chercheur ne peut plus se contenter d’être un gardien d’archives ; il doit devenir un architecte de la synthèse.

La standardisation de l’excellence et le nivellement par le haut

Le seuil de crédibilité académique subit présentement une mutation profonde. Lorsque n’importe quel étudiant, en utilisant habilement les systèmes de recherche offerts par l’IA, peut produire une analyse des structures de pouvoir d’une qualité formelle irréprochable, c’est toute la hiérarchie des compétences qui est bousculée. Ce que nous appelons aujourd’hui le « B+ automatique » n’est pas une preuve de médiocrité, mais le signe d’une industrialisation de la syntaxe savante. L’IA maîtrise les codes, les articulations logiques et le jargon nécessaire pour simuler une pensée rigoureuse. Cela nous place devant un paradoxe : alors que la qualité moyenne de la production par l’IA augmente, l’originalité réelle devient plus difficile à déceler. Le danger n’est pas que l’IA écrive mal, mais qu’elle écrive si « correctement » qu’elle finisse par imposer une norme de pensée lissée, dépourvue de ces aspérités et de ces intuitions qui font la grandeur de la recherche fondamentale.

Nous vivons une époque paradoxale. D’un côté, l’intelligence artificielle pulvérise nos limites biologiques et promet de résoudre les plus grands défis de l’humanité. De l’autre, elle installe une atrophie cognitive silencieuse et un contrôle social sans précédent.

Dans cet essai lucide et provocateur, le sociologue et linguiste Pierre Fraser analyse la trajectoire de l’IA non pas comme un simple outil, mais comme un fétiche moderne qui redéfinit notre rapport au savoir, à la justice et à la vérité. En s’appuyant sur une matrice analytique où la sagesse côtoie la folie, il nous interroge : que reste-t-il de l’humain quand l’algorithme prétend absorber la nuance et la morale ?

L’impasse de la productivité et le détournement de l’outil

On nous présente souvent l’IA sous l’angle de la performance : écrire plus vite, publier davantage, optimiser son temps. C’est une vision instrumentale qui, à terme, risque de vider le travail intellectuel de sa substance. Si l’on utilise ces outils uniquement pour augmenter notre rendement académique, nous entrons dans une logique de production de masse où l’humain n’est plus qu’un superviseur de processus automatisés. La véritable révolution n’est donc pas dans l’accélération, mais dans la transformation de notre rapport à la réflexion. La valeur ajoutée de l’IA ne réside pas tant dans sa capacité à nous remplacer dans les tâches ingrates de rédaction, mais bien dans sa faculté à agir comme un catalyseur de pensée. Au lieu de chercher à gagner du temps sur l’écriture, il s’agit d’investir ce temps dans une confrontation plus profonde avec l’objet de recherche.

La maïeutique1 artificielle comme levier de rigueur

À notre avis, c’est dans l’opposition que l’IA révèle son potentiel le plus fécond pour le chercheur universitaire. La tentation est grande d’utiliser ces modèles pour confirmer nos propres intuitions, mais l’usage le plus noble consiste à les transformer en adversaires dialectiques. Par exemple, dans le milieu académique, la critique entre pairs est souvent tempérée par des enjeux sociaux ou institutionnels ; l’IA, par sa neutralité froide, offre un miroir sans complaisance. En sollicitant une critique systématique de nos hypothèses, nous engageons dès lors un dialogue qui nous force à sortir de notre zone de confort intellectuel. Demander à une IA de traquer les biais dans un projet de recherche, c’est s’obliger à une auto-exigence renouvelée. Elle devient ce partenaire de réflexion infatigable qui ne cède pas à la politesse, nous poussant à affiner nos arguments jusqu’à ce qu’ils résistent à ses assauts logiques.

Vers une nouvelle éthique de la recherche augmentée

En fait, le pouvoir de l’IA n’est pas de substituer l’intelligence artificielle à l’intelligence humaine, mais de nous obliger à redéfinir ce qui nous est propre. En déléguant à l’IA la synthèse, la compilation et la vérification formelle, le chercheur est renvoyé à sa mission essentielle : le questionnement, le doute et la création de sens (définir correctement l’objet de recherche, poser des questions, formuler des hypothèses, argumenter et contre-argumenter). L’IA agit ainsi comme un serviteur et un challenger ; elle nous débarrasse du formalisme pour nous confronter à la nudité de notre pensée. C’est une opportunité unique de renforcer la solidité de nos travaux. En acceptant ce désaccord permanent avec l’algorithme, nous ne perdons pas notre autorité ; nous la fondons sur une base plus rigoureuse.

À l’ère de l’IA, la mise en scène de l’érudition, qui privilégie l’épate à la clarté, ne fait plus recette. L’usage de citations obscures ou de jargon cryptique pour marquer son rang dans la cummnauté académique ne suffit plus à asseoir une autorité. C’est précisément ce déclin qui plonge de nombreux chercheurs dans une certaine angoisse existentielle : l’IA a automatisé l’accès aux connaissances rares, brisant ainsi le monopole de l’érudition sélective.

[1] La maïeutique est, au sens socratique, l’art d’« accoucher les esprits ». Il s’agit d’une méthode de dialogue où, par un questionnement systématique, on aide l’interlocuteur à découvrir les vérités ou les idées qu’il porte en lui sans le savoir. Cela prend ici tout son sens : l’IA ne donne pas une vérité toute faite, mais par ses contradictions, elle aide le chercheur à « accoucher » d’une pensée propre, plus solide et mieux articulée.

© Pierre Fraser (PhD, linguiste et sociologue) + Sociologie Visuelle Média, 2026

SOURCES

- Singularité technologique : quand l’IA absorbe tout, même le social (Les cahiers du réel t. 1) – (CA | FR | UK | US)