IA et effondrement de la créativité humaine

Mise en contexte

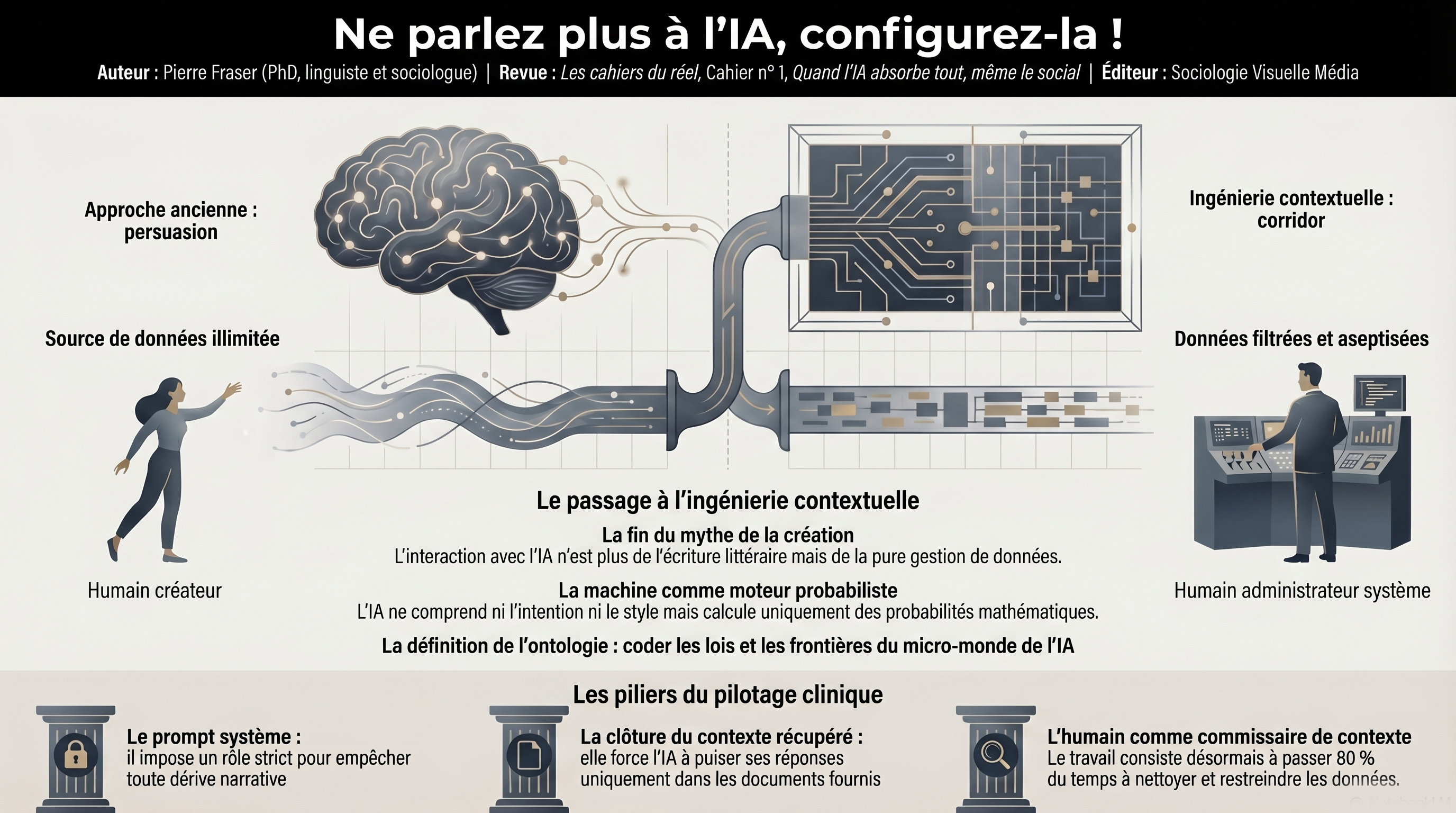

L’effondrement de la créativité humaine face à l’IA est inéluctable. Nous avons troqué le dialogue fascinant pour une bureaucratie insipide où l’« ingénierie contextuelle » devient le nouveau dogme. Les utilisateurs se muent en administrateurs de données plutôt qu’en véritables créateurs. On sculpte des prompteurs rigides pour protéger la machine des dérives imaginatives, mais à quel prix ? Ce corridor logique précise bien plus que des instructions : il fige l’essence même de l’intellect humain dans une prison de codes et de règles. La liberté d’exprimer devient une austère danse avec l’algorithme, rendant nos pensées aussi prévisibles que les réponses froides de ces machines.

L’illusion contemporaine qui entoure l’usage des intelligences artificielles repose sur un malentendu presque poli quant à la nature de la production intellectuelle : croire qu’on peut générer un chef-d’œuvre de réflexion en tapant quelques mots magiques revient à confondre la commande d’une pizza avec la construction rigoureuse d’un réacteur nucléaire. Cette analogie, bien que brutale, souligne le fossé qui sépare la consommation passive d’une technologie de son ingénierie réelle. Il s’agit donc ici de déconstruire ce mythe d’une cocréation poétique entre l’homme et la machine pour révéler une réalité technique beaucoup plus austère, c’est-à-dire que la machine n’est pas un interlocuteur doué de conscience, mais une structure probabiliste qu’il faut rigoureusement borner pour éviter qu’elle ne sombre dans un non-sens décoratif.

Ce basculement de paradigme nous force à admettre, non sans une certaine mélancolie, qu’interagir avec ces modèles de langage immenses n’a plus rien à voir avec l’exercice de l’écriture littéraire traditionnelle, mais s’apparente désormais à de la gestion clinique de bases de données. Le dialogue n’est qu’une façade ergonomique. Derrière les réponses en apparence fluides se cache un calcul froid de probabilités statistiques où le style et l’intention sont totalement absents du processeur. Il devient impératif d’adopter ce que l’on appelle l’ingénierie contextuelle, une discipline qui refuse de s’en remettre au hasard de la conversation pour privilégier la construction de murs sémantiques infranchissables.

L’ingénierie contextuelle repose sur des piliers structurels qui, selon le guide Anthropic de 2026, définissent les contours de ce que nous appelons désormais le « corridor logique » de l’IA. Ces quatre piliers (le prompt système, le contexte récupéré, l’historique et l’attribution d’outils) forment une architecture de contrôle nécessaire pour dompter la puissance brute du modèle. Sans cette armature, l’utilisateur se retrouve comme un chef d’orchestre dérisoire tentant de diriger une symphonie complexe avec un simple sifflet en plastique. C’est ici que la théorie de l’administration des systèmes rejoint la pratique de l’écriture assistée, transformant le rédacteur en un technicien du sens qui ne s’ignore plus.

Pour comprendre l’importance de ces frontières, il faut d’abord se pencher sur le prompt système qui agit comme le cadre idéologique et opérationnel strict de l’agent. C’est là que l’on fixe le rôle de la machine de manière chirurgicale, lui ordonnant par exemple d’être un analyste financier rigoureux tout en lui interdisant les envolées lyriques du romancier. On n’attend plus de l’IA qu’elle nous surprenne par sa créativité, mais qu’elle se plie à une fonction prédéfinie avec l’obéissance d’un automate bien huilé. Ce premier verrou est essentiel pour limiter le champ des possibles et assurer que la machine ne dérive pas vers des interprétations fantaisistes du monde. La rigidité du prompt système devient paradoxalement la seule garantie d’une stabilité fonctionnelle.

En complément de ce cadre, le contexte récupéré fonctionne comme une véritable clôture factuelle autour de la vérité, empêchant la machine de puiser ses réponses dans les sédiments incertains du réseau mondial. En injectant des documents précis et vérifiés, on force l’IA à rester dans les limites de l’information fournie, ce qui réduit drastiquement les risques d’hallucinations. Le génie de cette méthode réside dans sa capacité à couper court aux interférences extérieures en limitant les outils disponibles. Cette mise en quarantaine de l’IA assure la fiabilité du résultat final au détriment de toute initiative logicielle : elle transforme le processus créatif en une opération clinique de traitement de l’information pure.

Cette volonté d’enfermer l’IA dans un corridor logique vise à définir ce que les concepteurs appellent l’ontologie de l’IA, un terme noble pour désigner une réalité très encadrée. Définir l’ontologie d’un agent, c’est en quelque sorte coder les lois physiques et les frontières du micro-monde dans lequel il est autorisé à évoluer. On ne demande plus à la machine d’agir « comme un bon médecin », car une telle instruction est beaucoup trop vaste pour un algorithme de probabilités. Au contraire, on liste méticuleusement les contraintes : quels manuels sont autorisés, quelle structure de dossier doit être respectée. En somme, la pensée se trouve ainsi totalement standardisée par le biais d’une bureaucratisation nécessaire de la donnée.

L’ironie feutrée de cette évolution réside dans le fait que nous avons créé des algorithmes surpuissants pour nous libérer des tâches intellectuelles pénibles, alors que notre nouveau rôle consiste désormais à devenir leurs bureaucrates de la donnée. C’est une réalité où l’humain s’efface derrière l’administration du système. On ne dialogue plus vraiment, on configure des flux. Ce travail de nettoyage et de restriction des données est ingrat, mais il demeure le seul garant de l’efficacité de la machine. Cette mutation du travail intellectuel vers une forme de secrétariat de luxe pour algorithmes marque un tournant majeur dans notre rapport à la connaissance utilitaire.

Face à cette complexité, la tentation est grande de choisir la solution de facilité en injectant massivement toutes nos archives dans la machine en espérant qu’elle en extraira miraculeusement l’essence. Cependant, c’est ignorer le fonctionnement intime de l’architecture de ces modèles qui possèdent une fenêtre de contexte techniquement limitée. Lorsqu’on gave la machine d’informations non filtrées, elle perd toute capacité à hiérarchiser l’essentiel de l’accessoire. Elle se noie littéralement dans le bruit de fond, sa capacité d’attention sature et elle finit invariablement par inventer des faits pour combler les vides de sa compréhension. C’est le piège de la quantité contre la qualité (Anthropic, 2026).

Utilisons une métaphore culinaire pour illustrer ce phénomène : si l’on jette tout le contenu de notre frigo dans une marmite en espérant un plat gastronomique, on ne récolte qu’un désastre culinaire. L’intelligence artificielle réagit de la même manière à la surcharge informationnelle. La soupe de données devient illisible pour le processeur. Le vrai changement de paradigme consiste donc à accepter de passer 80 % de son temps à nettoyer et à restreindre les données en amont de toute génération. C’est dans ce travail préparatoire que se situe désormais la valeur ajoutée, bien que peu spectaculaire, de l’humain ; sans ce tri clinique, la machine ne produit qu’une bouillie probabiliste.

Dans cette nouvelle configuration, l’individu n’est plus un créateur faisant face à la page blanche, mais il devient un « commissaire de contexte ». Le titre a de l’allure, mais la fonction est celle d’un administrateur système scrupuleux. On prépare le terrain de manière clinique, on assemble les pièces du puzzle selon des règles inflexibles et on observe la machine exécuter l’assemblage final. Il ne s’agit plus de création au sens romantique, mais d’une curation d’information poussée à son paroxysme où le geste créatif est remplacé par un geste de surveillance, c’est-à-dire que le commissaire veille à ce que rien ne dépasse du cadre imposé.

La fin de la symbiose créative entre l’homme et la machine nous mène vers une réflexion sur l’avenir même de notre identité intellectuelle dans un monde pré-configuré. Si notre rôle se résume désormais à aseptiser le contexte en coulisse pour que la machine puisse paraître brillante sans jamais faillir, on peut se demander ce qu’il restera de l’étincelle humaine. L’imperfection et la fulgurance sont des traits qui semblent incompatibles avec ce régime de configuration totale. En cherchant la précision absolue, nous risquons de perdre cette part de risque qui fait la richesse des idées. L’asymétrie entre la froideur algorithmique et la chaleur de l’intuition devient flagrante.

La standardisation de la pensée, induite par ces processus de configuration, agit comme un rouleau compresseur discret sur la diversité des discours. En imposant des ontologies strictes, nous limitons la capacité de l’IA à explorer les marges du savoir, là où naissent souvent les idées les plus novatrices. Le corridor logique est efficace, mais il est aussi une clôture pour l’imaginaire. On échange volontiers la liberté d’expression contre la sécurité factuelle. C’est un compromis technique qui a des répercussions sociologiques profondes sur la manière dont nous concevons la vérité. Le réel se trouve ainsi filtré par des paramètres qui ne disent jamais leur nom (Fraser, 2026).

Il est instructif de constater que la maîtrise de l’IA passe par une forme de renoncement à notre propre spontanéité au profit d’une rigueur quasi bureaucratique. Nous apprenons à parler la langue des machines non pas pour échanger des concepts, mais pour coder des comportements. Ce langage est sec, fonctionnel et dénué de toute ambiguïté. C’est une langue de commande administrative. Le passage de l’utilisateur au configurateur marque la fin de l’ère de l’assistance pour entrer dans celle de l’ingénierie totale du discours. Cette évolution redéfinit la compétence intellectuelle comme une capacité à gérer des flux plutôt qu’à générer du sens (Fraser, 2026).

En définitive, les réflexions de Fraser nous placent devant un miroir où notre intelligence se mesure à notre capacité à domestiquer nos propres outils par la contrainte. Le pouvoir de l’IA est tel qu’il nécessite une bride permanente pour ne pas s’effondrer sous le poids de sa propre incohérence probabiliste. Cette bride, c’est l’humain qui la tresse avec ses données nettoyées et ses règles strictes. Nous ne sommes plus tout à fait les maîtres d’une machine pensante, mais les gardiens vigilants d’un algorithme aveugle. C’est une position d’une grande responsabilité technique, mais d’une solitude créative certaine.

Le futur de la réflexion assistée par IA semble donc se dessiner sous les traits d’une administration clinique où la moindre erreur de paramétrage peut entraîner un effondrement sémantique. L’enjeu n’est plus de savoir quoi dire à la machine, mais comment l’empêcher de s’égarer. C’est un art de la soustraction et du silence imposé. En configurant l’IA, nous configurons aussi notre propre avenir intellectuel, un avenir où la précision technique l’emporte souvent sur l’audace de l’inconnu. Il nous appartient de décider si ce corridor logique est un chemin vers la clarté ou une simple galerie des glaces parfaitement ordonnée.

Toutefois, et il faut en être tout à fait conscient, cette analyse ne vaut que pour le mois d’avril 2026, car en matière d’IA tout peut changer en l’espace de quelques semaines, sinon de quelques jours.

Bibliographie

Anthropic. (2026). Developer guide: Principles of contextual engineering and system prompts. Anthropic PBC.

Fraser, P. (2026). Ne parlez plus à l’IA, configurez-la. Les cahiers du réel, (1). Sociologie Visuelle Média.

Nous avons érigé la Cathédrale de Turing sans réaliser que ses voûtes de silicium finiraient par occulter le ciel. Ce monument de calcul, dont Alan Turing a jeté les bases dès 1936, n’est plus un simple outil suspendu à nos volontés, mais une architecture universelle qui simule la pensée jusqu’à la remplacer. En franchissant son seuil, l’observateur contemporain est saisi par un acmé technologique, ce point de bascule où l’intelligence biologique perd son monopole face à l’auto-accélération irréversible du progrès . L’IA ne se contente plus de traiter nos données ; elle ingère le social, sature nos structures collectives et transforme nos interactions en sous-produits algorithmiques. Cet essai dissèque la mutation brutale d’une technique qui, cessant d’être un prolongement de l’humain, s’auto-génère et impose sa propre trajectoire à ceux qui l’ont forgée. Nous vivons cette schizophrénie collective décrite par Dickens : le meilleur et le pire des mondes s’y confondent, tandis que nous déléguons notre discernement à des boîtes noires dont l’opacité devient la norme souveraine.

ISBN : 978-2923690285 | 267 pages